Generative AIは日本語では「生成AI」などという意味不明の翻訳をされてしまっています。

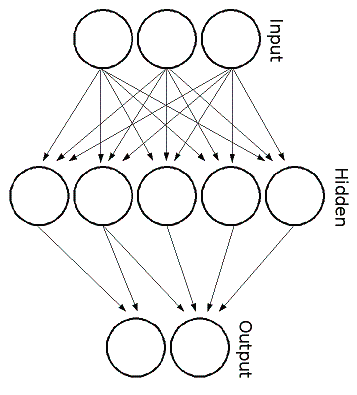

もともとAIの世界では(まさか簡単に世に広まると思われず)バズワード扱いでした。というのも、テキスト、音声、音楽、イメージ、あらゆるものを入力とし、出力する(generateする)AIのことです。

しかし、多くのIT企業が生成する結果の社会的モラルをおそれ、発表を躊躇していた中ChatGPTが発表され、各社も公表せざるを得なくなりました。

今でもGenerative AIが差別的な表現を出力したらどうするか?という問題は解決していません。

私のこのブログでも何度か書いておりますが、AIはパターンを真似ているだけで、コンピューター自身はその意味は理解していません。

誤った入力があれば、それに応じた出力をするまでです。現在、わかりやすい現象はChatGPIにとてもプライベートなことや、ニッチな専門分野を質問してもきちんと回答が帰ってきません。

しかし、哲学者マルクス・ガブリエルは使う方の人類に警鐘を鳴らしています。

それはAIを使うことで、「人は理論的、科学的なものを信じ、考えることを止めるからだ」といいます。

もしあなたが、この「」内を読んで、それのどこがいけないの?と思ったのであれば、とてもマズイです。

科学とは、科学的な態度は常に必要ですが、理論自身は常に揺れ動いています。たとえば、原子は原子核の周りを電子が回っている、という原子構造は100年前に作り出されたモデルですが、しばらくは信じられていました。

いや、いまだにこれを信じて「原子はスカスカだ」と言っている人がいます。

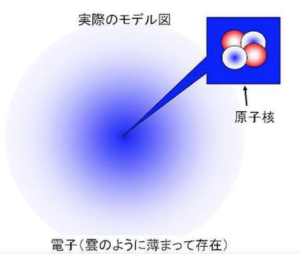

しかし、量子力学の出現により、電子の位置は確率的に記述することしかできない、とされています。つまり場所を検出するまでは電子は確率的存在なのだそうです。

(上の絵はこちらから拝借しています。ありがとう)

しかし、高校で原子の周りを電子がくるくる回っている図をイメージしながら、分子構造を学んだはずで、科学の化合物の実験するとそのとおりの結果が出ます。

このように科学の理論とは常に真実を示しているとも限らず、だからといって真実を示していない姿が誤りだというわけでもないのです。

真実を知るためには多くの前提知識を知らないといけないものは、数多くあります。

しかし受験で勉強に苦手意識を持ってしまい、ひいては自分で考えることをやめ、常識や権威に弱い人が日本にはとても多いと思います。

「◯◯先生のおっしゃっていることだから間違いない」「お前ごときが◯◯先生のおっしゃることに逆らうのか」よく聞く言葉ですね。

たとえば、櫻澤如一先生のおっしゃることは間違いないと自分で考えることはしないでマクロビオテック(通称マクロビ)を盲信している人はたくさんいます。

「日本人は無宗教」と言っている人がいますが、新興宗教のせいで神仏が出てくる話を信じないだけで、「常識」とか「科学的」とかいうものを考えずに信じてしまうことは形を変えた宗教だと私は思います。

同様にAIのいうことを盲信し、自分で調べたり他の考え方を受け入れないということが起こりがちな国民性といえると思います。